La plupart des fiches produit que j’audite ont le même défaut : trop de schemas, pas assez de signal. Un Product, un Review, un FAQPage collé à la FAQ du menu, un HowTo importé d’un template, un BreadcrumbList en double. Résultat côté Search Console : Merchant listings avec warnings, Product snippets invalides, AggregateRating fantôme.

La question en 2026 n’est pas combien de propriétés on empile. C’est lesquelles Google lit vraiment, lesquelles les LLMs parsent, et lesquelles sont vérifiables dans le DOM visible. Selon Aleyda Solis (State of Ecommerce SEO 2025), 18 % des sites e-commerce ne sont toujours pas intégrés à Google Merchant Center. Et chez ceux qui le sont, l’incohérence entre le feed et le JSON-LD du site reste une cause majeure de disqualification.

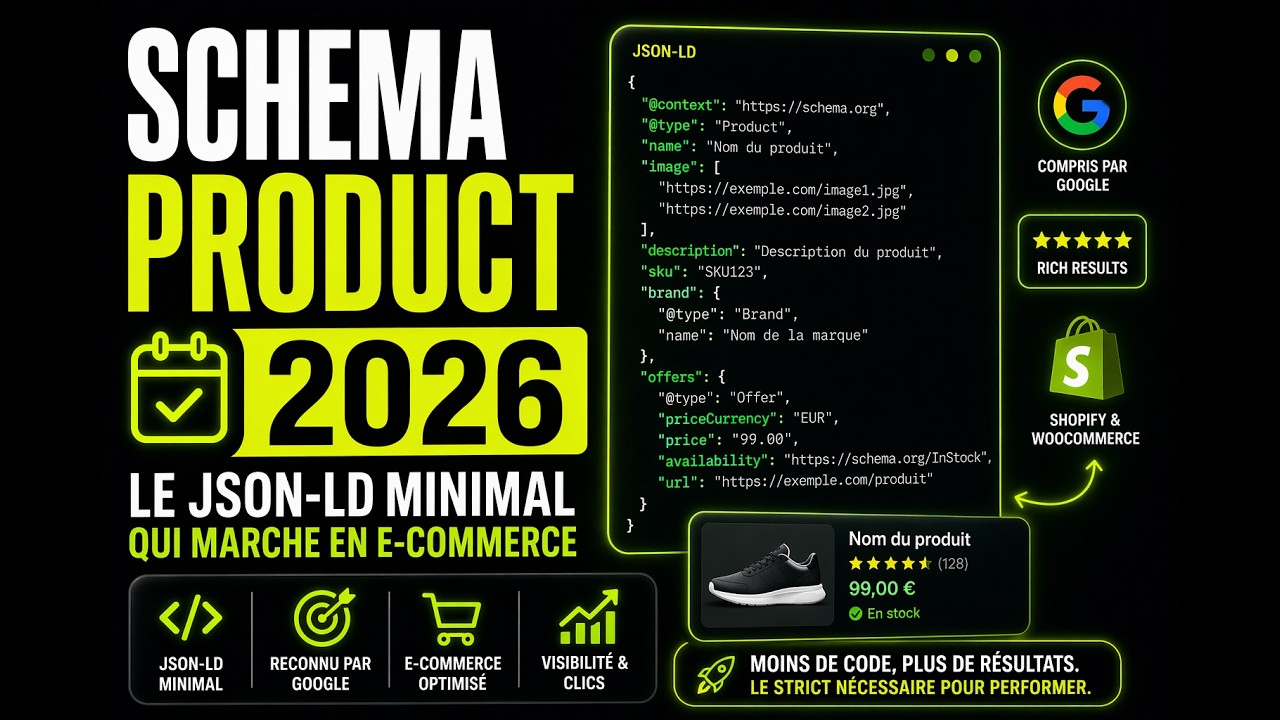

Le code qui suit, c’est la stack Product + Offer + AggregateRating qu’on pose chez nos clients : ça passe les validateurs, ça colle au feed Merchant Center, et ça se fait lire par ChatGPT Search, Perplexity et Google AI Overviews.

Pourquoi la stack Schema minimale bat la stack maximaliste en 2026

La stack qui déclenche rich results et citations LLM tient en 8 propriétés Product, 5 propriétés Offer et un AggregateRating vérifiable. Empiler FAQPage, HowTo générique et BreadcrumbList dupliqué n’apporte ni CTR ni bénéfice LLM. Pire : ça augmente le risque de structured data manual action dès qu’un validateur détecte un mismatch.

La règle Google qui tranche vient des General Structured Data Guidelines, mise à jour le 2026-01-06 :

“Don’t mark up content that is not visible to readers of the page. Don’t mark up irrelevant or misleading content, such as fake reviews or content unrelated to the focus of a page.”

Si le DOM visible ne confirme pas le markup, la page perd son éligibilité rich result. Les manual actions structured data ne touchent pas le ranking web classique, mais elles coupent 100 % de l’affichage enrichi. Sur une fiche produit qui vit du CTR SERP, c’est sanglant.

Les mauvais réflexes qu’on voit constamment :

- Empiler FAQPage sur chaque page produit avec les mêmes questions copiées-collées. Trigger anti-spam quasi garanti.

- Dupliquer BreadcrumbList parce que le thème le génère et qu’une app (Judge.me, Yoast, peu importe) en ajoute un deuxième

- Injecter un AggregateRating orphelin avec ratingValue 4.8 alors qu’aucune review scrollable n’existe à côté

- Déclarer un HowTo sur une fiche produit qui n’a aucune instruction étape par étape visible à l’œil nu

| Pattern | Effet visible | Effet caché |

|---|---|---|

| Stack minimale (Product + Offer + AggregateRating) | Rich snippets shopping, étoiles, prix | Matching Merchant Center stable, citations LLM |

| Stack maximaliste (+ FAQPage + HowTo + Breadcrumb ×2) | Parfois des étoiles en plus | Warnings Search Console, risque manual action |

| Stack orpheline (AggregateRating sans reviews DOM) | Étoiles qui disparaissent après crawl | Perte d’éligibilité review snippet |

Le principe : côté feed Merchant Center, on complète avec les flux produit, et côté site on garde inline ce qui est réellement visible à l’écran. Moins, mais crédible.

Les 8 propriétés obligatoires pour Product en 2026

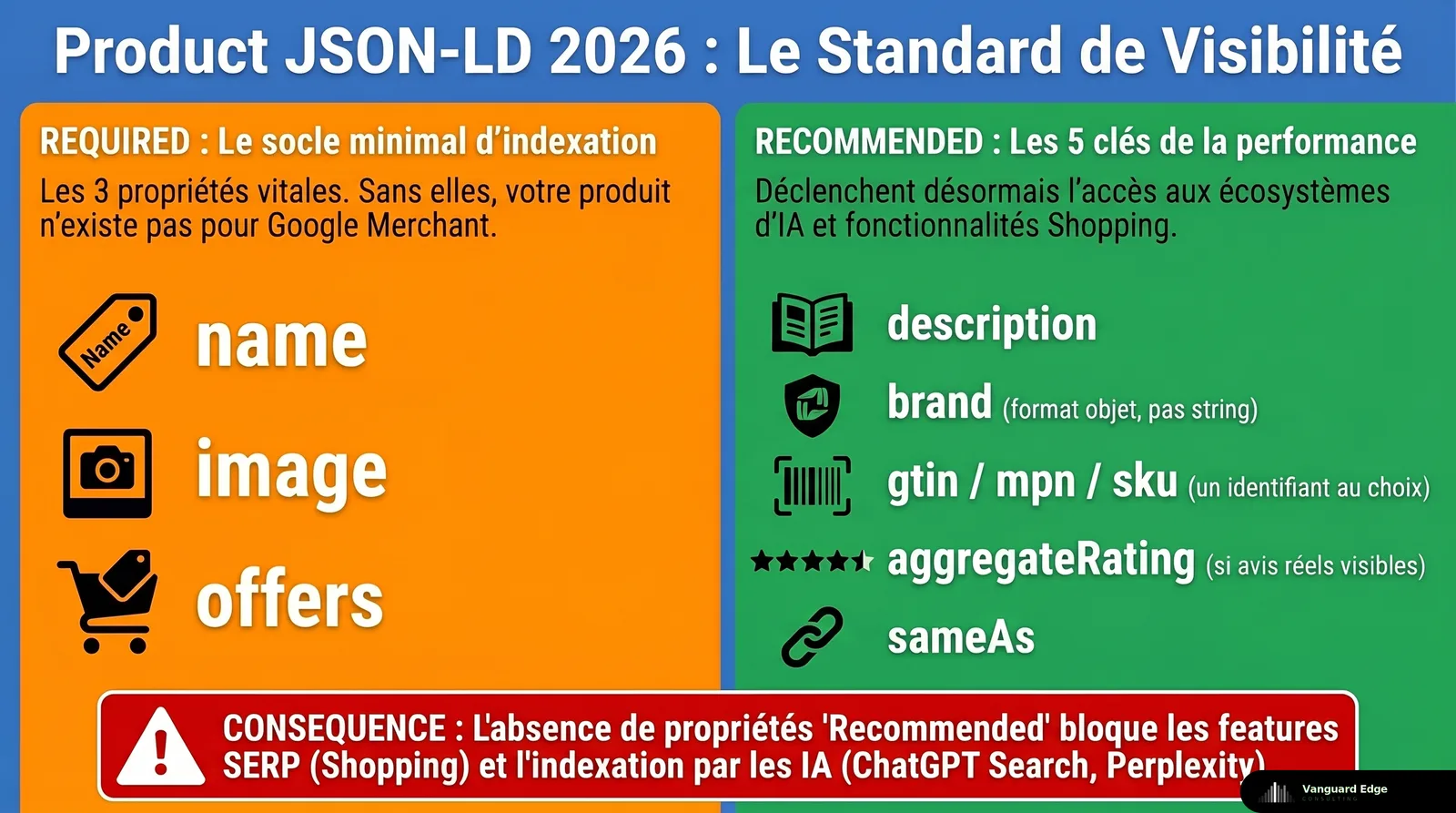

Les 8 propriétés minimales d’un Product JSON-LD conforme 2026 : name, image, description, brand, au moins un identifiant parmi (gtin, mpn, sku), offers, aggregateRating (uniquement si reviews réelles), sameAs. Google exige strictement name, image, offers pour être éligible merchant listing. Les autres conditionnent l’éligibilité aux rich results shopping et l’extraction par ChatGPT Search ou Perplexity.

La doc Google Merchant Listing est explicite sur le découpage : name, image, offers sont required ; description, brand.name, gtin/mpn/sku, aggregateRating, review, color, material, pattern, size sont recommended. Sans les recommandés, la plupart des features SERP shopping ne déclenchent tout simplement pas.

Identifiants produit : gtin, mpn, sku

Règle Google : “Use the most specific GTIN that applies”. Ordre de préférence :

gtin: Global Trade Item Number (gtin8 / gtin12 / gtin13 / gtin14 selon le packaging). Meilleur matching cross-marchand.mpn: Manufacturer Part Number. Obligatoire pour les marques propres sans GTIN attribué.sku: identifiant interne du marchand. En complément des deux autres, jamais comme remplacement seul.

Les trois ne sont pas mutuellement exclusifs. Sur une fiche Shopify, il est normal d’avoir les trois côte à côte. Pour Apparel, Google recommande fortement size, color, pattern et material pour apparaître correctement dans les expériences Apparel. Attention à un piège classique : gender et ageGroup ne sont pas des propriétés directes de Product. Elles se déclarent via audience : audience.suggestedGender, audience.suggestedMinAge, audience.suggestedMaxAge.

Offer : price, priceCurrency, priceValidUntil, availability, itemCondition

Cinq propriétés Offer à ne pas manquer :

price: obligatoire. “Merchant listing experiences require a price greater than zero” (Google). Prix à 0, page inéligible, point final.priceCurrency: ISO 4217 (EUR, USD…). Requis pour merchant listing, recommandé pour un product snippet simple.priceValidUntil: non requis, mais très fortement recommandé sur les promos. Sans date de fin, Google peut considérer le prix comme stale.availability: URL schema.org (InStock,OutOfStock,PreOrder). Toute désynchro avec le stock réel génère un warning Search Console.itemCondition:NewConditionpar défaut. Critique pour les marketplaces et le reconditionné.

Un mot sur les enhancements récents. Google recommande d’utiliser hasCertification plutôt que l’ancienne hasEnergyConsumptionDetails pour déclarer les certifications énergie. Et pour les promos, priceType (sale price) et validForMemberTier (member price, encore marqué recommended/beta) sont mutuellement exclusifs dans une même spécification Offer. Si vous avez une promo publique et un prix membre, il faut deux Offer séparés ou alterner selon la logique business. Jamais combiner les deux dans le même bloc.

Brand en objet, pas en string

L’erreur la plus fréquente qu’on corrige : "brand": "Acme". Ça passe le validateur schema.org pur, mais Google préfère nettement l’objet typé :

"brand": {

"@type": "Brand",

"name": "Acme",

"url": "https://acme.example.com"

}La forme objet rattache Brand à un site officiel, ce que les LLMs utilisent pour désambiguïser les marques homonymes. Un string brut sans URL, et ChatGPT Search doit deviner de quelle Acme on parle.

sameAs : l’ancrage entité pour les LLMs

Propriété sous-utilisée, gros ROI en 2026. Schema.org : “URL of a reference Web page that unambiguously indicates the item’s identity.” En clair : les URLs externes qui certifient l’identité du produit ou de la marque.

"brand": {

"@type": "Brand",

"name": "Acme",

"sameAs": [

"https://fr.wikipedia.org/wiki/Acme",

"https://www.wikidata.org/wiki/Q12345",

"https://www.linkedin.com/company/acme"

]

}Aleyda Solis résume le sujet : “Schema markup helps AI systems understand your entity”, avec comme requirement explicite pour les marques qui gagnent en AI search : “Organization schema and sameAs links to major profiles”. Sans ancrage sameAs, le produit reste parseable par Google mais opaque pour le layer entité que ChatGPT Search et Perplexity se construisent en parallèle.

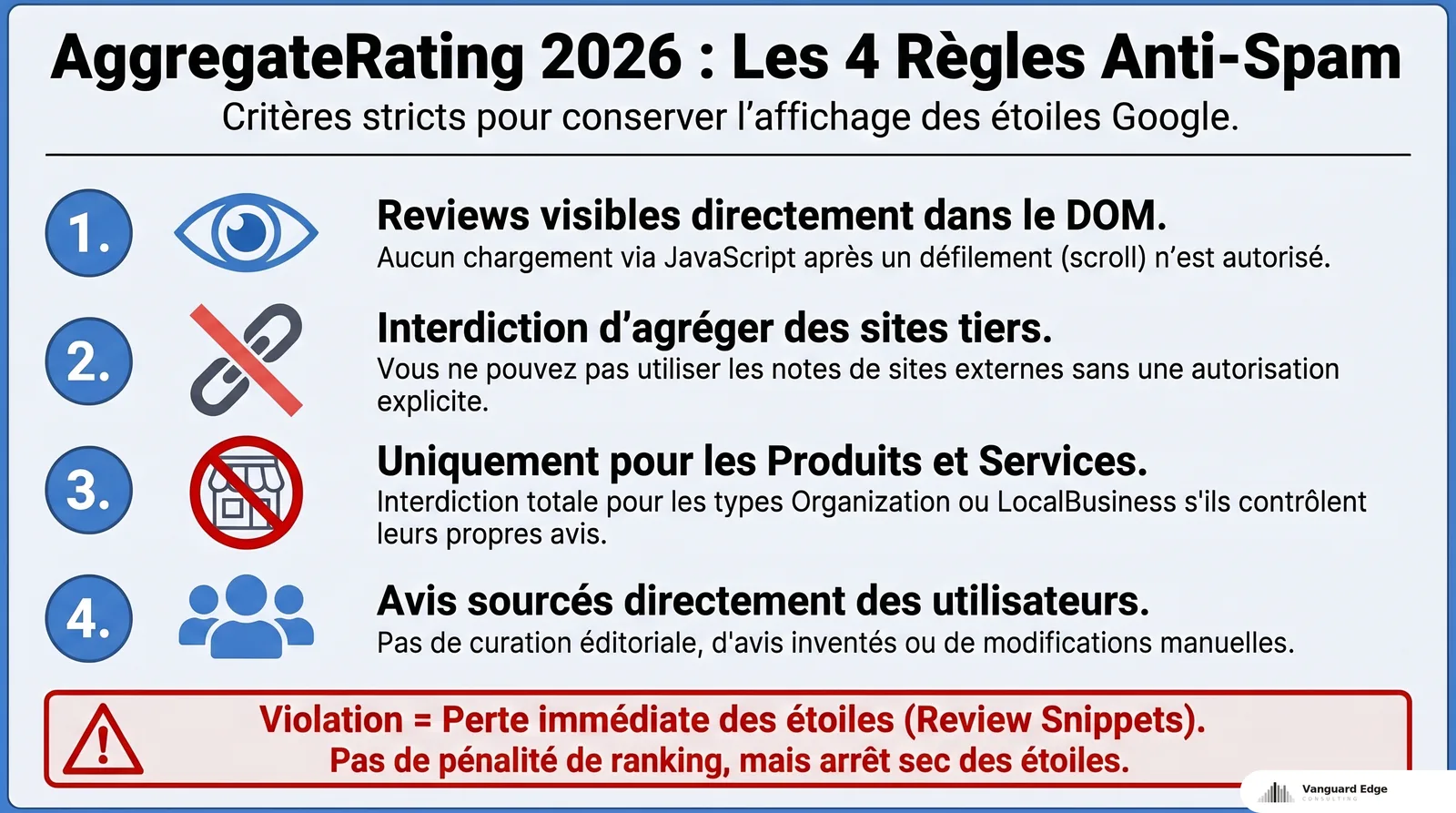

AggregateRating en 2026 : les 4 règles anti-spam à respecter

Quatre règles Google s’appliquent en 2026, sourcées dans sd-policies et la doc Review Snippet. Les reviews doivent être visibles dans le DOM côté utilisateur final. Pas d’agrégation cross-site : on n’agrège pas des ratings venant de sites tiers sans autorisation. Pas de self-serving rating pour Organization ou LocalBusiness (uniquement produits, œuvres et services). Les reviews doivent être sourcées directement des utilisateurs, pas curated éditorialement et certainement pas inventées. Violation de l’une des quatre, et c’est la perte d’éligibilité review snippet. Pas de pénalité ranking, mais arrêt sec des étoiles SERP.

Verbatim Google :

“Make sure the review content you mark up are readily available to users from the marked-up page. It must be immediately obvious to users that the page has review content.”

SSR : conséquence pratique de la règle visibilité DOM

La première règle impose que les reviews soient visibles dans le DOM au moment du crawl. En pratique, ça pousse vers un rendu côté serveur ou un HTML initial qui contient déjà les avis. Un widget qui hydrate les reviews après un scroll ou un onclick peut passer complètement sous le radar du crawler. Ce n’est pas une 5e règle en plus, c’est juste la condition pour respecter la première.

Sur une boutique de cosmétique qu’on a auditée en mars, AggregateRating ratingValue 4.9 sur 3 avis affichés en JS après scroll : étoiles disparues en 11 jours après crawl, -14 % de CTR SERP sur les fiches concernées. Le fix tenait en une ligne de template Liquid : rendre les avis dans le HTML initial plutôt qu’après interaction.

Un seuil pratique, pas une règle officielle

Aucun texte Google ne fixe officiellement de minimum de reviews. Schema.org exige seulement ratingValue plus ratingCount ou reviewCount. Mais dans la pratique observée sur plusieurs comptes clients : en dessous de quelques avis réels et datés, Google peut ignorer les étoiles SERP même si le markup est techniquement valide. Les filtres qualité semblent plus sévères sur les AggregateRating anémiques.

Conséquence directe : pas d’AggregateRating sur une fiche à 1 ou 2 avis. Mieux vaut pas d’étoile qu’une étoile fantôme qui saute au premier recrawl.

Review imbriqué : author, datePublished, reviewRating

Un AggregateRating sans Review nested = rating orphelin, chiffre sans preuve. La structure qui passe :

"aggregateRating": {

"@type": "AggregateRating",

"ratingValue": "4.6",

"reviewCount": "127",

"bestRating": "5",

"worstRating": "1"

},

"review": [

{

"@type": "Review",

"author": { "@type": "Person", "name": "Claire D." },

"datePublished": "2026-03-14",

"reviewRating": {

"@type": "Rating",

"ratingValue": "5",

"bestRating": "5"

},

"reviewBody": "Livraison en 48h, produit conforme à la description."

}

]Trois champs obligatoires par Review : author (Person ou Organization), datePublished en ISO, reviewRating avec ratingValue. Et un reviewBody visible à l’écran pour fermer la boucle.

Source externe vérifiable vs reviews internes

Widget Trustpilot, Avis Vérifiés, ou reviews internes stockées en base de données ? Les deux marchent, mais sous conditions :

- Reviews internes : persistance HTML obligatoire, auteur et date vérifiables, pas de modération cachée des avis négatifs

- Widget externe : rendu DOM côté serveur, pas d’iframe JavaScript qui charge après

Règle Google : “If the entity that’s being reviewed controls the reviews about itself […] are ineligible for star review feature.” Elle cible surtout les pages About et Service. Pour une fiche Produit c’est plus souple, mais toujours pas d’agrégation cross-site : interdiction de scraper les notes Amazon pour les afficher chez soi. Pour comprendre pourquoi le SEO e-commerce joue par ses propres règles sur ce genre de détails de confiance et d’éligibilité, voir l’article dédié.

Quand ne PAS mettre d’AggregateRating

Les cas où ne pas déclarer d’AggregateRating est la bonne décision :

- Fiche produit neuve sans historique d’avis réel

- Page catégorie (AggregateRating s’applique à un produit unique, pas à un ItemList)

- Homepage de la boutique

- Produit configurable avec des variantes aux notes très différentes

- Pages About / Services où l’entité contrôle ses propres reviews

Un AggregateRating sans reviews visibles dans le DOM, c’est une manual action en attente.

Le code complet : page produit + page catégorie (ItemList)

Sur une page produit, un seul <script type="application/ld+json"> avec Product + Offer + AggregateRating nested dedans. Sur une page catégorie, un ItemList dont chaque item pointe vers une fiche via URL. Pas deux blocs Product sur la même page. Pas de Breadcrumb dupliqué.

JSON-LD Product simple : le code commenté

{

"@context": "https://schema.org/",

"@type": "Product",

"name": "Sac à dos urbain Vanguard 20L",

"image": [

"https://example.com/img/sac-vanguard-1x1.jpg",

"https://example.com/img/sac-vanguard-4x3.jpg",

"https://example.com/img/sac-vanguard-16x9.jpg"

],

"description": "Sac à dos urbain 20 litres en polyester recyclé, compartiment ordinateur 15 pouces, garantie 5 ans.",

"sku": "VNG-BKP-20-BLK",

"mpn": "VNG20BLK",

"gtin13": "3456789012345",

"brand": {

"@type": "Brand",

"name": "Vanguard Gear",

"url": "https://example.com",

"sameAs": [

"https://fr.wikipedia.org/wiki/Vanguard_Gear"

]

},

"offers": {

"@type": "Offer",

"url": "https://example.com/sacs/vanguard-20l",

"priceCurrency": "EUR",

"price": "89.00",

"priceValidUntil": "2026-12-31",

"availability": "https://schema.org/InStock",

"itemCondition": "https://schema.org/NewCondition",

"seller": {

"@type": "Organization",

"name": "Vanguard Gear"

}

},

"aggregateRating": {

"@type": "AggregateRating",

"ratingValue": "4.6",

"reviewCount": "127",

"bestRating": "5",

"worstRating": "1"

}

}Huit propriétés Product, cinq Offer nested, un AggregateRating vérifiable. Le bloc passe Rich Results Test sans warning, à condition que les images soient crawlables et le prix supérieur à 0.

JSON-LD Product avec variantes : ProductGroup

Pour les produits déclinés (tailles, couleurs), Google a rollout ProductGroup depuis février 2024 :

{

"@context": "https://schema.org/",

"@type": "ProductGroup",

"name": "Sac à dos urbain Vanguard 20L",

"description": "Sac à dos 20 litres en polyester recyclé.",

"productGroupID": "VNG-BKP-20",

"variesBy": [

"https://schema.org/color",

"https://schema.org/size"

],

"brand": { "@type": "Brand", "name": "Vanguard Gear" },

"hasVariant": [

{

"@type": "Product",

"sku": "VNG-BKP-20-BLK",

"color": "Noir",

"offers": {

"@type": "Offer",

"price": "89.00",

"priceCurrency": "EUR",

"availability": "https://schema.org/InStock"

}

},

{

"@type": "Product",

"sku": "VNG-BKP-20-GRN",

"color": "Vert forêt",

"offers": {

"@type": "Offer",

"price": "89.00",

"priceCurrency": "EUR",

"availability": "https://schema.org/OutOfStock"

}

}

]

}Anti-bloat : name, brand et description apparaissent une seule fois dans le parent. Les variants ne répètent que ce qui diffère vraiment (sku, color, offers). variesBy pointe vers les URLs schema.org complètes, pas des strings.

JSON-LD page catégorie : ItemList

Une page catégorie ne doit pas contenir de schema Product. Elle contient un ItemList, rien d’autre :

{

"@context": "https://schema.org/",

"@type": "ItemList",

"itemListElement": [

{

"@type": "ListItem",

"position": 1,

"url": "https://example.com/sacs/vanguard-20l"

},

{

"@type": "ListItem",

"position": 2,

"url": "https://example.com/sacs/nomad-15l"

}

]

}Chaque ListItem porte seulement une position et une URL. Les détails (prix, image, nom) restent sur la fiche cible. Ça évite les warnings de duplication et ça garde la fiche comme source unique de vérité.

Validation multi-outils : ce que chaque validateur détecte (et manque)

Un markup valide dans Rich Results Test peut très bien être rejeté par Search Console deux semaines plus tard. Les quatre outils à combiner en 2026 : Rich Results Test pour la structure et l’éligibilité feature, Schema.org Validator pour la conformité spec pure, Search Console Merchant listings / Product snippets pour la réalité post-crawl, et les logs serveur pour confirmer que Googlebot a bien vu le JSON-LD. Les trois premiers ne remplacent pas les logs, même si on aimerait bien.

| Outil | Ce qu’il détecte | Ce qu’il manque |

|---|---|---|

| Rich Results Test (search.google.com/test/rich-results) | Erreurs de type Google, éligibilité feature, warnings de champs recommandés manquants | État réel d’indexation, comportement post-CSR avec délai rendu |

| Schema.org Validator | Conformité spec schema.org pure, erreurs de syntaxe, types invalides | Exigences Google spécifiques (merchant listing vs product snippet) |

| Search Console Enhancements | Réalité post-crawl : ce que Google voit après indexation | Ne reflète le déploiement qu’après 7 à 14 jours |

Logs serveur (grep Googlebot) | Confirmation que Googlebot a hit l’URL et récupéré le HTML avec JSON-LD | Ne dit rien sur la validation sémantique |

Cas typique vécu chez un client Shopify en février : Rich Results Test affichait Éligible merchant listing, Schema.org Validator passait au vert, mais Search Console remontait 80 % des pages produit en “Invalid price” deux semaines plus tard. Coupable habituel : un rendu JavaScript qui injecte le prix après hydration, que Googlebot n’a tout simplement pas attendu.

SSR vs client-side : le JSON-LD au premier crawl

Googlebot rend le JavaScript, mais en deux passes : un crawl HTML initial, puis un rendu JS ultérieur. Entre les deux, l’écart peut aller jusqu’à plusieurs jours selon la complexité du rendu (observation terrain, non chiffrée publiquement par Google). Si le JSON-LD est injecté côté client après hydratation, il est absent du premier snapshot d’indexation. Règle 2026 : JSON-LD obligatoire dans le HTML initial. Soit SSR (Next.js, Remix, Hydrogen), soit static generation (Astro, Nuxt static), soit pré-rendu au build.

Aleyda Solis est explicite :

“Something also important is to avoid structured data implementation with CSR JS. Not only reviews, but also descriptions or images end up over-relying on CSR JS, making it challenging for Google to index at scale.”

Par CMS :

- Shopify : éditer

theme.liquidouproduct.liquidpour injecter le script dans le<head>. Vérifier que les apps rendent bien côté serveur (Judge.me, Stamped, à surveiller). Hydrogen SSR gère nativement. - WooCommerce : hook

wp_headou filterwoocommerce_structured_data_product. À éviter absolument : les plugins qui injectent en footer JS. - Headless (Next.js, Remix) :

next/scriptavecstrategy="beforeInteractive"ou injection directe dans<Head>. Jamais dans unuseEffect, c’est la pire option.

Le test qui tranche en 10 secondes :

curl -A "Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html)" \

https://votre-boutique.com/sacs/vanguard-20l \

| grep -o 'application/ld+json'Si grep ne retourne rien, votre JSON-LD n’est pas dans le HTML initial. Prix et stock mettront plusieurs jours à s’indexer correctement. Et d’ici là, Google peut déjà avoir servi l’ancien prix en SERP.

Hiérarchie de lecture : Google, ChatGPT Search, Perplexity

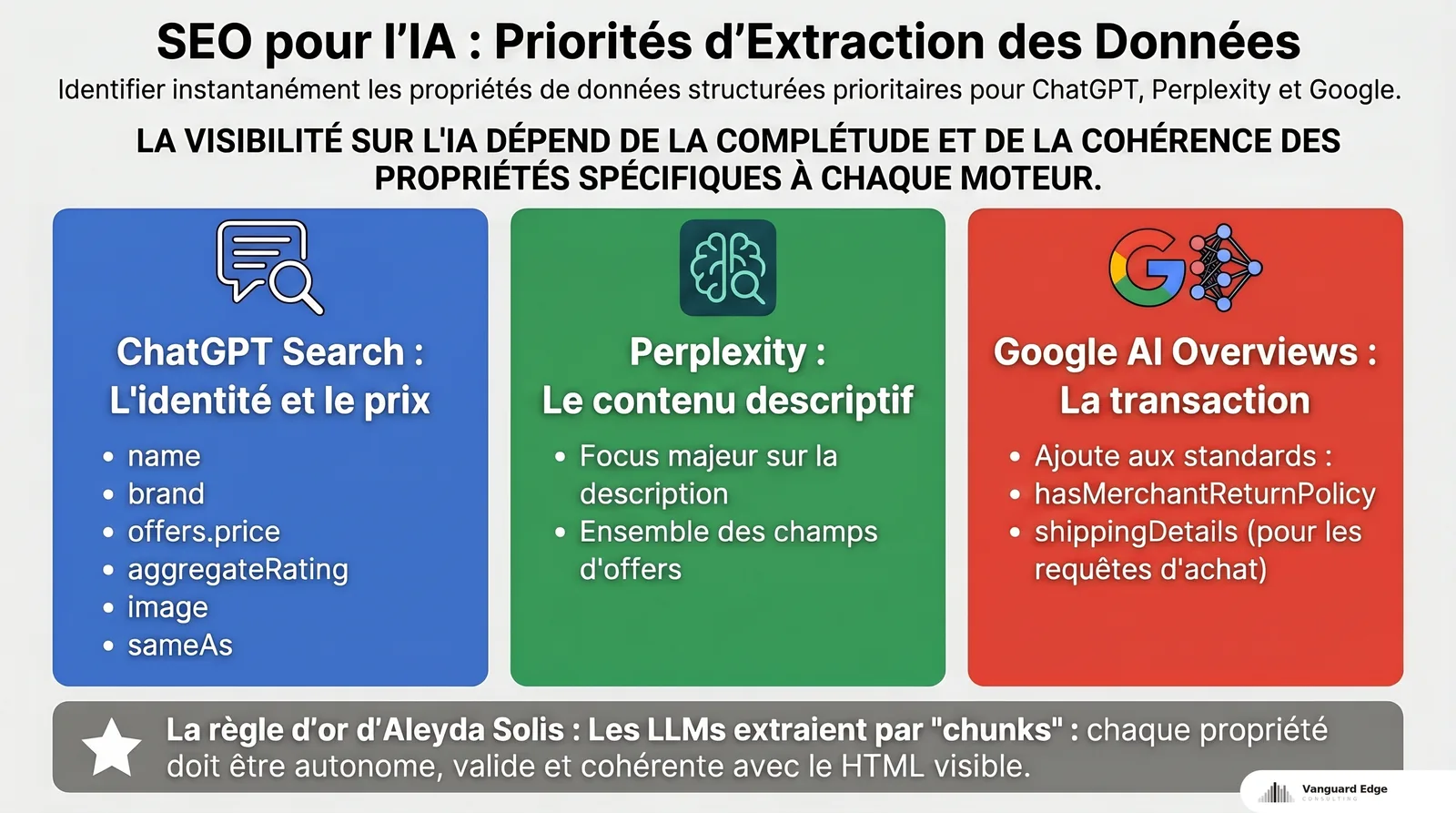

À lire comme hypothèse de travail, pas comme vérité mesurée (aucun des trois moteurs ne publie sa hiérarchie de lecture). Mais sur la base des travaux d’Aleyda Solis et de nos propres tests manuels en prompt, les LLMs ne priorisent clairement pas les mêmes champs que le crawler Google classique. ChatGPT Search semble extraire en priorité name, brand, offers.price, aggregateRating, image et sameAs. Perplexity s’appuie davantage sur description et les champs d’offers. Google AI Overviews ajoute hasMerchantReturnPolicy et shippingDetails sur les requêtes transactionnelles.

Aleyda verbatim dans AI Search Winning Brands : les LLMs retrieve “in chunks”. Conséquence directe : chaque propriété doit être autonome, valide et cohérente avec le HTML visible. Un champ isolé doit pouvoir être cité sans contexte.

Implications concrètes :

nameetbrandsont la porte d’entrée. Toujours en forme objet avecurletsameAsrenseignéssameAssur Brand et Product reste le levier le plus sous-exploité pour être cité nommément par ChatGPT Searchdescriptiondoit inclure les entités et les termes du marché cible (Perplexity est le plus description-dependent des trois)hasMerchantReturnPolicyetshippingDetailsjouent le rôle de bonus côté Google AI Overviews, surtout sur les requêtes transactionnelles

Pour creuser ce que les LLMs extraient vraiment d’une page produit, l’article complémentaire détaille la priorisation par moteur. Le JSON-LD reste une brique parmi d’autres, voir la stack GEO complète pour être cité par ChatGPT.

Checklist d’implémentation step-by-step

Onze points actionnables avec validation objective. Chaque étape bloque la suivante tant qu’elle n’est pas validée.

- Audit existant : Rich Results Test sur 5 URLs produit représentatives. Lister les warnings et erreurs.

- Inventaire identifiants : exporter

gtin,mpnetskupour tous les SKU actifs. - Template JSON-LD : un par type de page (fiche simple, variantes, catégorie). Valeurs plausibles testées.

- Injection côté serveur : theme Liquid pour Shopify,

wp_headpour WooCommerce,<Head>natif pour Next.js ou Astro. Jamais de plugin qui injecte en footer JS. - Test curl -A Googlebot :

application/ld+jsonapparaît dans le HTML récupéré sans exécuter une ligne de JavaScript. - Rich Results Test : zéro erreur. Warnings uniquement s’ils sont justifiés.

- Schema.org Validator : zéro erreur de syntaxe pure.

- Staging puis production : pas de déploiement direct en prod sans re-test staging.

- Monitoring Search Console : 14 jours de surveillance sur les rapports Merchant listings et Product snippets. Pic d’Invalid = rollback immédiat.

- Alignement feed Merchant Center :

gtin,brand,availabilityetpriceen priorité. C’est la règle de parité d’Aleyda Solis. - Test LLM : prompt ChatGPT Search et Perplexity avec “Peux-tu me citer la fiche produit X sur le site Y ?” Observer si le prix, la brand et la disponibilité ressortent correctement.

Conclusion

Huit propriétés Product, cinq Offer, un AggregateRating vérifiable. Le tout rendu côté serveur et aligné avec votre feed Merchant Center. FAQPage dupliqué, HowTo orphelin, Breadcrumb en double : c’est du bloat qui fait perdre des rich results, pas en gagner.

Sur les 40+ boutiques qu’on a accompagnées ces trois dernières années, celles qui tenaient une stack minimale stable ramassaient les Popular Products et les citations ChatGPT Search. Celles qui empilaient les schemas « au cas où » récoltaient surtout des warnings Search Console et des étoiles qui sautaient au recrawl.

Vous voulez savoir où en est votre boutique sur cette stack ? Le pré-audit est gratuit : audit.vanguard-edge-consulting.com. 100+ points de contrôle. Et ce n’est pas un PDF de 80 pages.

L'analyse en deux voix

Deux consultants discutent de ce sujet — données, cas terrain, implications business.

Lire la version texte

Je suis ravie de lancer ce nouveau décryptage aujourd'hui, on va parler d'un truc qui nous concerne absolument tous.

Tout à fait, ravie d'être là.

On va aborder un sujet assez colossal, ouais.

Bah oui, parce que la façon dont on découvre et dont on achète des produits en ligne est en train de subir une transformation, enfin, une transformation radicale, quoi.

C'est le mot.

Le paysage du e-commerce est méconnaissable par rapport à il y a quelques années.

Exactement.

Et le but de notre exploration en profondeur aujourd'hui, c'est vraiment de décoder un langage technique secret, un langage que les marques sont obligées d'utiliser si elles veulent survivre face aux nouveaux moteurs de recherche et bien sûr à l'intelligence artificielle.

Ouais, l'enjeu est vital pour elles.

Et pour faire ça, on a épluché une belle pile de documents techniques.

Ok, oui.

On s'appuie sur les directives officielles de Google Search Central, les définitions très strictes du code de Schema.org et surtout, et ça c'est passionnant, les analyses stratégiques d'Alida Solis.

Ah, Alida Solis, ouais.

Ses projections sur le SEO e-commerce pour 2025 et sur les marques qui vont gagner face à l'IA en 2026 sont incontournables.

Carrément.

Ok, décortiquons tout ça.

Pour ceux qui nous écoutent, quiconque a déjà cherché un produit en ligne s'est forcément demandé pourquoi certains articles dominent tout l'écran, tu vois.

Avec de grandes images, des avis, les prix en temps réel, ouais.

Voilà.

Pendant que d'autres disparaissent purement et simplement dans les limbes du web, eh bien on a enfin la réponse technique à ce mystère.

Et la première chose à acter, c'est vraiment la mort du fameux lien bleu.

Ah, le lien bleu.

C'est fou quand on y pense.

Il y a 10 ans, chercher en ligne, c'était un peu comme utiliser le catalogue papier d'une bibliothèque.

C'est une bonne image, tiens.

Ben oui, tu tapais un mot-clé et bam, une liste bien ordonnée de liens bleus apparaissait.

Tu cliquais, tu naviguais, c'était linéaire.

Mais aujourd'hui ?

Aujourd'hui, les pages de résultats, ce qu'on appelle les SERPs, elles ressemblent plutôt à des pages de catalogue de produits, des PLP.

Ouais, c'est comme entrer dans un centre commercial magique.

Les étagères se réorganisent toutes seules, en temps réel, sous tes yeux.

Et le but, c'est d'empêcher de sortir du magasin.

Ils veulent que la transaction se fasse là, direct dans le couloir.

C'est exactement ça.

Avec des caroussels dans tous les sens, des panneaux de connaissances sur le côté, des filtres hyper précis et ça a complètement changé le comportement des gens.

J'imagine, ouais.

Les fameuses recherches sans clics, non ?

Voilà.

Les recherches zéro clics augmentent de façon spectaculaire.

Par exemple, l'analyse montre une hausse de 4,63% des recherches sans clics pour une catégorie comme les écouteurs sans fil.

Waouh !

4,63% !

C'est énorme !

Ouais.

L'utilisateur voit le prix, l'autonomie, la réduction de bruit directement sur Google.

Et il n'a même plus besoin de cliquer sur le site de la marque.

C'est super logique pour un truc technique.

T'as juste besoin de savoir si le casque a le Bluetooth 5.0, oui ou non.

Pas besoin de lire un roman d'introduction.

Tout à fait.

Mais attention, ce n'est pas le cas pour tous les secteurs.

L'étude montre que pour les robes de soirée, par exemple, les recherches sans clics ont baissé de 3,51%.

Ah, intéressant.

Donc la tendance s'inverse pour la mode.

Bah oui, parce qu'on n'achète pas une robe comme on achète une carte graphique.

L'acheteur a besoin de voir le drapé, le contexte visuel, comment ça rend sur différentes morphologies.

C'est clair.

Mais du coup, quand les gens cliquent, où est-ce qu'ils vont ?

Parce que l'analyse montre de gros perdants, là.

Ah, sur mobile, c'est un vrai carnage pour certains.

Les grands perdants, ce sont les publications non spécialisées.

Genre les gros sites d'actu qui font de la filiation ?

Exactement.

Comme The Guardian ou TechRadar.

Et même des immenses détaillants historiques comme Macy's qui perdent énormément de terrain.

Mais au profit de qui, du coup ?

Au profit des sites de contenu générés par les utilisateurs.

Reddit, Instagram, TikTok.

Ah ouais, la preuve sociale pure et dure.

C'est ça.

L'algorithme a compris que les gens veulent des avis bruts, réels.

Même avec des fautes d'orthographe.

Plutôt qu'un test aseptisé écrit par un gars qui teste une tondeuse le matin et une télé l'après-midi.

C'est dingue.

Donc la page de résultats est scindée.

D'un côté, la transaction immédiate.

Et de l'autre, le forum pour l'expérience vécue.

Parfaitement résumé.

Bon.

Alors la vraie question, c'est comment un produit fait pour atterrir sur ses étagères magiques hyper-visibles plutôt que d'être envoyé aux archives du Cléa ?

Il lui faut un passeport très spécifique.

C'est là qu'on entre dans le dur.

Le fameux passeport numérique Vision.

On parle du JSON-LD, c'est ça ?

Exactement.

Système déstructuré.

Exactement.

Le format JSON-LD, pour être éligible aux résultats enrichis, c'est le standard absolu aujourd'hui.

J'ai épluché les directives de Schema.org et franchement, c'est pas juste une balise qui dit « voici un T-shirt à vendre ».

Ah non, ça demande une granularité folle.

Ouais.

Avec le type Offer, par exemple, il faut tout spécifier.

La monnaie avec Price Currency, l'état du stock avec Availability et même un truc qui s'appelle Price Valid Until, pour donner la date de fin du prix.

Et ce qui est fascinant ici, c'est le niveau de rigueur syntaxique imposé par Google.

Le moteur de recherche ne lit pas la page visuelle avec ses jolies couleurs, il lit le code source brut.

Ouais, il est aveugle au design en fait.

Totalement aveugle.

Du coup, les règles sont martiales.

Par exemple, pour les décimales d'un prix, il faut utiliser un point et surtout pas une virgule.

Attends, même si en France, on écrit 49,99 euros sur la page web visuelle ?

Oui.

Dans le code JSON-LD, ça doit impérativement être écrit 49,99.

Et avec des chiffres unicode standard, de 0 à 9.

Pas de symbole monétaire fantaisiste dans la valeur, sinon ça casse.

Laisse-moi faire l'avocat du diable une seconde.

Une marque peut avoir un produit incroyable, une pub à un million de dollars, et si le développeur met une virgule au lieu d'un point dans le code, le produit est invisible sur Google.

C'est ça.

Si le parseur de Google lit une virgule, il croit que c'est une séparation dans une liste.

La donnée devient corrompue et bam, disqualifiée de la zone premium.

C'est impitoyable.

Mais attends, j'ai une question par rapport aux sources.

On est quand même en 2026, les sites sont hyper dynamiques.

Ouais, gérés par Javascript en grande partie.

Voilà.

Si le produit est rendu dynamiquement par du Javascript, le robot de Google ne peut pas simplement le lire comme un humain.

Pourquoi les documents déconseillent fortement d'utiliser le Javascript côté client pour générer ces données structurées ?

C'est un piège redoutable.

En fait, le robot de Google fonctionne en deux vagues d'exploration bien distinctes.

Comment ça, deux vagues ?

La première vague, elle est immédiate.

Le robot télécharge le HTML brut, ça ne lui coûte pas cher en énergie.

Mais exécuter du Javascript, ça demande énormément de ressources.

Ah, je vois.

Donc il le met de côté.

Exactement.

Il place la page dans une file d'attente de rendu.

Et cette deuxième vague peut n'arriver que des jours, voire des semaines plus tard.

Oula.

Donc si je fais une vente flash pour le week-end et que mon prix JSON-LD est injecté par Javascript, Google risque de ne voir la promo que le mardi suivant.

Tu as tout complet.

Et c'est catastrophique pour le taux de rebond si un client clique sur un produit affiché en stock sur Google, mais qui est épuissé sur ton site depuis deux jours à cause de ce décalage.

Ouais, l'expérience utilisateur est flinguée.

Donc la règle d'or, c'est le JSON-LD directement codé dans le HTML initial.

Sans exception.

Mais structurer un prix, c'est la base.

La vraie galère, c'est de gérer le chaos des variantes.

Ah oui, l'exemple classique du e-commerce, le vêtement.

Si j'ai un manteau d'hiver qui existe en 5 tailles et 4 couleurs, ça fait techniquement 20 produits différents.

C'est là qu'intervient la notion de product group.

C'est indispensable.

J'adore l'analogie pour expliquer ça.

C'est exactement comme des poupées russes.

Les fameuses matrioshkas.

C'est une excellente façon de le visualiser, oui.

La grande poupée, à l'extérieur, c'est le product group.

Elle dit juste « manteau d'hiver en laine marque X ».

Et quand on l'ouvre, on trouve toutes les petites poupées à l'intérieur.

Et chaque petite poupée représente une variante via les attributs AS Variant ou Varis Buy.

Voilà, une poupée, c'est le modèle bleu, taille S.

L'autre, le modèle rouge, taille M.

Mais le secret, d'après les documents, c'est que chaque petite poupée doit avoir son propre SKU et surtout sa propre URL spécifique, non ?

Absolument essentiel.

Souvent avec un paramètre dans l'URL du genre point d'interrogation couleur égale bleu.

Comme ça, le robot indexe la bonne image bleue quand l'utilisateur cherche spécifiquement ce coloris.

C'est fascinant cette structuration.

Mais il n'y a pas que les couleurs et les prix.

Il y a aussi la question de la preuve sociale, les avis.

Ah, les aggregate ratings et les reviews.

Le nerf de la guerre.

C'est ça qui donne les petites étoiles dorées sur les résultats Google.

Mais les documents montrent que la récréation est terminée à ce niveau-là.

Google a durci le ton.

De façon très agressive.

Ils exigent des notes basées sur de vrais utilisateurs, avec un auteur et une date.

Fini les avis écrits par promo 50%.

Et la règle anti-triche la plus dingue, c'est celle sur les avis auto-centrés.

Avant, un commerce local, genre un plombier, pouvait très bien écrire 10 faux avis super positifs sur son propre site, mettre le code aggregating rating, et hop, il avait 5 étoiles sur Google.

C'est totalement banni aujourd'hui.

L'entité ne peut plus être jugée partie.

Même s'ils utilisent un petit widget d'avis tiers sur leur site ?

S'ils contrôlent directement l'affichage de ce widget et peuvent filtrer les mauvais retours, c'est interdit.

Il faut que ce soit validé par des plateformes externes indépendantes.

Ok, donc structurer tout ça parfaitement, c'est la base pour survivre en 2025.

Mais pour l'étape d'après, l'ère de l'intelligence artificielle en 2026, l'analyse d'Anleida Solis montre qu'il faut aller encore beaucoup plus loin, non ?

L'IA change complètement le paradigme.

Elle ne fait pas que lister des liens, elle synthétise l'information pour donner des réponses directes.

Et pour être citée par l'IA, il faut respecter ce que Solis appelle les 10 commandements des marques gagnantes.

Parlons des 3 traits majeurs qu'elle met en avant.

Le premier m'a beaucoup frappé, l'information doit être extractable.

Oui, extractable, ça veut dire facile à isoler pour la machine.

Concrètement, ça veut dire une seule idée par paragraphe, des définitions claires, des résumés directs, genre sujets, verbes, compléments.

Si on noie les spécifications d'un produit dans un texte littéraire interminable, l'IA ne fera pas l'effort de le comprendre.

Elle passera à un concurrent plus clair.

C'est ruve pour les rédacteurs.

Le deuxième trait, c'est d'être reconnaissable et cohérent.

C'est l'idée que l'entité de la marque doit être rigoureusement la même partout.

Sur le site web, sur LinkedIn, sur Crunchbase, dans les communiqués de presse, partout.

Et c'est là qu'on utilise la propriété Schema Same As, c'est ça ?

Pour lier tous ces profils ensemble dans le code.

Tout à fait.

Mais si on relit cela à la vue d'ensemble, c'est le troisième trait qui est le plus difficile à obtenir.

L'information doit être corroborée.

Ah, la corroboration.

Ça veut dire que même si mon code JSON-LD est parfait, l'IA ne va pas me croire sur parole.

Non, l'IA a une peur bleue des hallucinations.

Elle a besoin de sources tierces indépendantes pour valider tes affirmations.

S'il n'y a pas de relations publiques externes, de presse ou de forum qui parlent de toi, l'IA ignorera ta donnée structurée.

Donc le SEO technique ne suffit plus du tout.

Exactement.

Ça n'a pas remplacé les fondamentaux du SEO, ça a juste exacerbé le besoin de confiance absolue et de clarté.

Bon, mais attends, je dois te poser la question.

Ça signifie quoi pour le marketing ?

Les marques doivent arrêter d'écrire de la belle prose et commencer à écrire comme des robots.

Juste des listes à puces pour être extractables, ça va être d'un ennui mortel.

C'est le paradoxe de notre époque.

La réponse courte, c'est non, il ne faut surtout pas écrire comme un robot.

Ouf, tu me rassures.

En fait, il faut une architecture à double détente.

Le squelette de ta page doit être ultra structuré pour la machine.

Mais la chair autour, le contenu réel, doit être le plus humain possible.

C'est indispensable pour le haut de tunnel.

C'est ça que j'ai adoré dans les documents.

C'est le paradoxe humain.

Pour s'imposer face à l'IA, la solution ultime, c'est de créer du contenu hyper humain tout en haut de l'entonnoir d'acquisition.

Oui, parce que les sites d'affiliation généraliste perdent la bataille.

L'IA cherche de la véritable expertise vécue.

Les sources donnaient des exemples super parlants.

Nordstrom, par exemple.

Le géant de la mode, oui.

Au lieu de juste vendre des vêtements, ils font des guides de style complet.

Des conseils de mode hyper pointus.

Et pareil pour Shwee, le site pour animaux.

Ils font des articles ultra détaillés sur la santé vétérinaire.

C'est exactement la bonne stratégie.

Ils prouvent leur autorité topique sur le sujet.

Et cette autorité coule ensuite vers les pages de produits.

Les fameuses PDP.

Et ces pages de produits, elles doivent être blindées de contenus générés par les utilisateurs.

Le fameux UGC.

C'est vraiment la boucle qui se boucle.

Oui.

L'IA a besoin de preuves que des humains utilisent ce produit.

Des photos de clients, des avis détaillés, de la vraie expertise de terrain.

De véritables experts humains.

L'authenticité, c'est la seule chose que l'IA ne peut pas générer elle-même de manière crédible.

Elle a besoin de la vampiriser chez nous.

Alors, qu'est-ce que tout cela signifie pour ceux qui nous écoutent ?

En gros, la maîtrise de l'information aujourd'hui est bilingue.

C'est une belle façon de le formuler.

Bah oui.

D'un côté, il faut parler couramment le JSON LD pour les machines.

Avec une rigueur absolue.

Et de l'autre, offrir une expertise humaine, bordelique parfois, mais irremplaçable.

Et cela soulève une question importante sur la façon dont nous naviguons tous.

La décision d'achat se prend de plus en plus sur l'écran de recherche lui-même.

Avant même d'arriver sur le site d'une marque.

Ouais, on regarde les avis, on compare les prix dans le carousel et c'est plié.

Et ça, ça m'amène à une réflexion finale.

Un truc qui me trotte dans la tête depuis qu'on a préparé ce sujet.

Je t'écoute.

Si les systèmes d'IA deviennent vraiment les gardiens absolus du e-commerce.

S'ils filtrent uniquement l'effet extractable et surtout corroborés par tout l'historique d'Internet.

Ah ouais ?

Est-ce qu'une nouvelle marque super disruptive qui se lance aujourd'hui, sans des décennies d'autorité préexistante, pourra encore percer ce mur algorithmique à l'avenir ?

C'est une question effrayante franchement.

N'est-ce pas ?

Est-ce que l'IA va finir par figer les monopoles actuels pour l'éternité parce qu'ils ont le plus de corroboration historique ?

Franchement, c'est un mystère passionnant qu'il va falloir observer de très près dans les années à venir.

On n'a pas fini d'en parler, ça c'est sûr.

C'est certain.

Merci de m'avoir accompagné pour ce grand plongeon dans le code et les algorithmes.

Avec grand plaisir.

Et pour tous ceux qui nous écoutent, on se retrouve très vite pour un prochain décryptage.

La vidéo explicative

Comment implémenter le Schema Product minimal sur une page e-commerce

Durée : 30 min- 1

Auditer la page actuelle

Lancer un Rich Results Test sur l'URL produit pour lister les propriétés détectées et les erreurs éligibilité merchant listing.

- 2

Inventorier les identifiants produit

Rassembler gtin, mpn et sku pour chaque SKU. Un identifiant minimum suffit, mais la hiérarchie gtin puis mpn puis sku donne le meilleur matching.

- 3

Injecter le JSON-LD côté serveur

Placer le bloc script type=application/ld+json dans le HTML initial (theme Liquid pour Shopify, wp_head pour WooCommerce). Jamais en footer JS.

- 4

Valider sur trois outils

Passer le code dans Rich Results Test puis Schema.org Validator puis vérifier le rapport Enhancements de Search Console 14 jours après déploiement.

- 5

Aligner avec le feed Merchant Center

Vérifier que chaque propriété déclarée côté site correspond au flux produit Merchant Center, surtout gtin, brand, availability et price.

Questions fréquentes

Combien de propriétés sont strictement requises pour un Product JSON-LD en 2026 ?

Pour être éligible merchant listing sur Google, trois propriétés sont requises : name, image et offers (avec Offer.price et Offer.priceCurrency en ISO 4217). Pour un product snippet simple, name suffit plus une propriété parmi review, aggregateRating ou offers. Les identifiants gtin ou mpn sont recommandés, pas obligatoires.

Peut-on afficher des étoiles AggregateRating avec seulement quelques avis ?

Schema.org exige au moins ratingValue et un des deux champs ratingCount ou reviewCount, sans minimum officiel Google. Dans la pratique observée, en dessous d'une poignée d'avis réels datés, Google peut ignorer les étoiles même si le markup est valide. Mieux vaut ne pas déclarer qu'afficher des étoiles fantômes non visibles sur la page.

Le JSON-LD injecté en JavaScript est-il lu par Google ?

Oui, mais avec plusieurs jours de décalage entre le crawl HTML et le rendu JavaScript. Pour une fiche produit dont le prix et le stock changent, cet écart signifie un risque d'indexation avec des données périmées. Google et Aleyda Solis recommandent explicitement le rendu côté serveur ou le HTML initial, surtout pour reviews, descriptions et images.