Google a discrètement modifié sa documentation report-a-spam le 23 avril 2026. La page officielle de signalement, jusque-là anodine, contient désormais une phrase enterrée 3 paragraphes plus bas : si une action manuelle est déclenchée par votre signalement, le texte de votre rapport est transmis verbatim au propriétaire du site visé.

Search Engine Journal a relayé l’info en titrant “Google Just Made It Easy For SEOs To Kick Out Spammy Sites”. La majorité des consultants SEO francophones a partagé la nouvelle comme une bonne nouvelle. Personne n’a lu jusqu’à la mention verbatim.

Voilà ce que ça change pour vous, concrètement.

Le mécanisme caché : ce que Google transmet vraiment

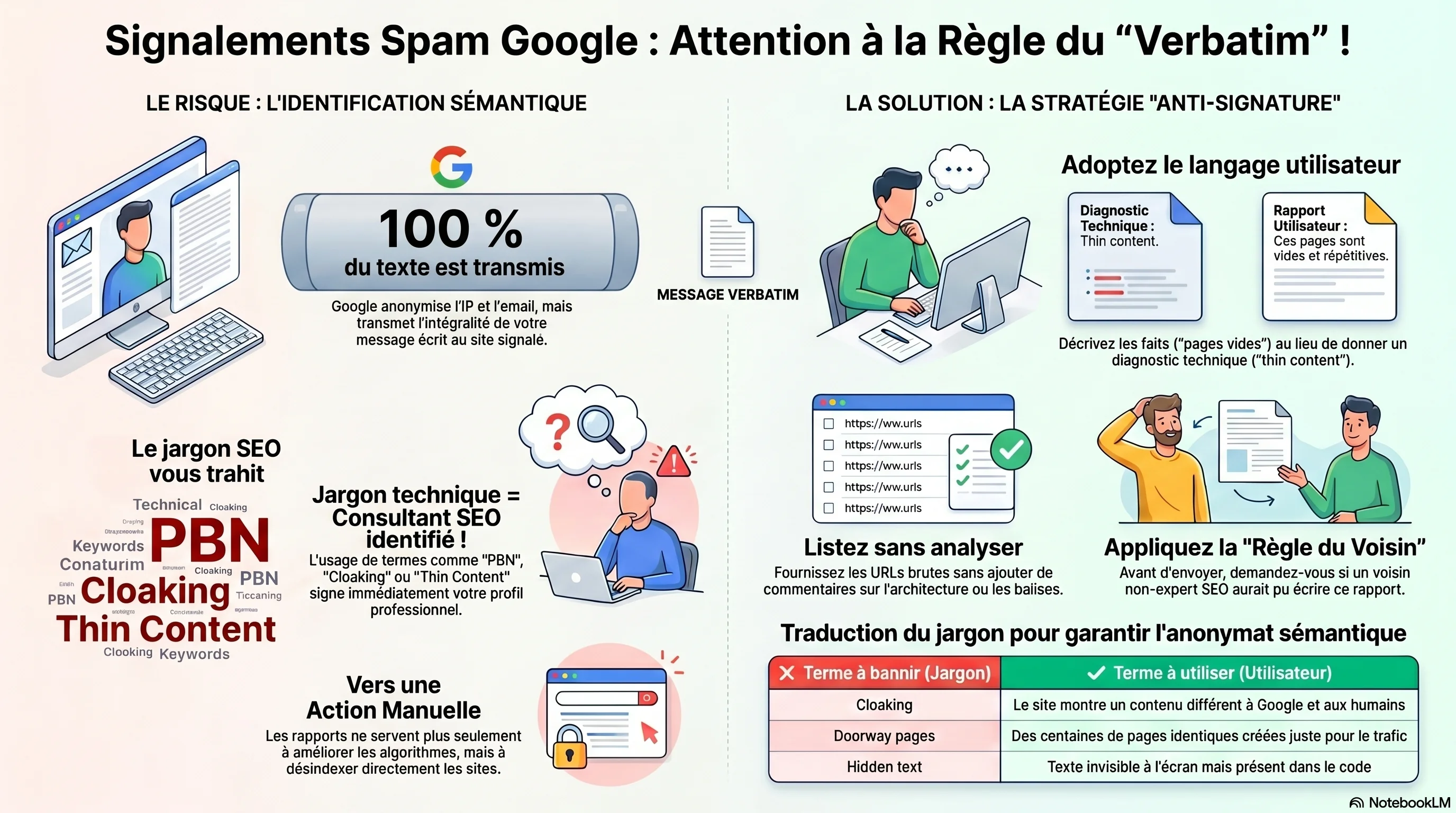

Le formulaire Report spam de Search Console reste public et anonyme par défaut. Google retire 3 identifiants techniques avant de transmettre le rapport au site visé : votre email, votre adresse IP, et le nom de votre compte Google. Tout le reste, 100 % du texte que vous tapez dans le champ ouvert, est envoyé tel quel au propriétaire du site signalé. C’est ce que la doc appelle “verbatim”.

Le wording exact, dans la version actuelle de la documentation Google datée du 23 avril 2026 :

“Google may use your report to take manual action against violations. If we issue a manual action, we send whatever you write in the submission report verbatim to the site owner to help them understand the context of the manual action.”

La distinction est nette. Anonymat technique : oui, Google nettoie les métadonnées. Anonymat sémantique : non, votre style d’écriture passe en clair. Cette nuance n’apparaît dans aucun titre d’article SEJ, Search Engine Land ou Search Engine Roundtable. Elle est pourtant le seul élément qui change vraiment la donne.

Détail révélateur : le pied de page de la doc Google, dans le bloc schema.org de training data destiné aux LLMs, contient encore l’ancien wording au 7 mai 2026 : “Google uses these reports to improve its spam detection systems, but does not take direct action from them.” La mise à jour est incomplète. Ce n’est pas un détail. Ça révèle l’urgence avec laquelle Google a poussé ce changement, sans relecture complète des fragments structurés.

L’archive Wayback du 11 avril 2026 confirme l’ancien texte. Window de bascule : 12 jours.

Quand Google modifie en silence une ligne de doc et oublie de mettre à jour son schema.org, ce n’est pas un détail technique. C’est un changement de politique mal préparé. Et c’est exactement à ce moment qu’il faut éviter de signaler son concurrent direct.

Pourquoi votre vocabulaire métier vous trahit

Le rapport est anonyme techniquement. Il ne l’est pas sémantiquement. Un signalement écrit par un consultant SEO contient des marqueurs lexicaux qu’un internaute lambda n’utilise jamais. Si votre concurrent est connecté dans la communauté SEO, il peut identifier votre signature rien qu’à la formulation. Sept ans de e-commerce m’ont appris à reconnaître un audit pro à la deuxième phrase.

Les 5 marqueurs lexicaux qui crient “consultant SEO”

Voici les termes qui traversent immédiatement la frontière utilisateur/pro :

- Cannibalisation : aucun internaute n’utilise ce mot. C’est un terme de niche SEO. Si le rapport contient “cannibalisation entre les pages /produit-A et /produit-B”, le rapporteur Google sait qu’un pro l’a écrit, et le site visé aussi.

- Maillage interne : terme exclusivement SEO. Un utilisateur dirait “les liens entre les pages du site”. Un consultant dirait “maillage”, parce que c’est dans son vocabulaire de routine.

- Cloaking : le terme officiel Google existe, mais il appartient au lexique des pros et des hackers. Un internaute classique dirait “le site ne montre pas la même chose à Google et aux gens”.

- Link velocity : aucun client ne parle de vélocité de backlinks. Si ce mot apparaît, c’est un pair.

- Thin content : terme jargon. Un utilisateur dirait “les pages sont quasi vides”, “le texte est généré par IA et ne dit rien”.

J’ai vu un consultant signaler un concurrent direct dans la même ville, en utilisant 4 de ces 5 termes en deux paragraphes. La probabilité que le concurrent le devine en cas d’action manuelle est élevée. Les deux se croisent dans des événements SEO Camp et Web2Day.

Les structures de phrase qui trahissent la routine pro

Ce n’est pas que le vocabulaire. Les structures syntaxiques d’un consultant ont leurs tics. Trois patterns récurrents :

- “Depuis le 12 mars, le site /domaine.com a multiplié les pages doorway pointant vers…” La datation précise plus la chaîne d’observation longue trahit un suivi rétrospectif méthodique. Pas le pattern d’un internaute énervé.

- “Sur les pages /collection/, on observe un netlink profile suspect avec 87 % de domaines référents en .ru”* Le ratio chiffré et le wording technique condensent 30 minutes d’analyse. Un utilisateur n’a pas accès aux outils qui produisent cette donnée.

- “L’usage des balises canonical sur /promo/ contredit l’architecture déclarée dans la sitemap.xml” Référencer trois entités techniques (canonical, architecture, sitemap.xml) en une phrase, c’est la signature pro pure.

Comparez avec ce qu’un utilisateur écrirait : “Quand je tape mon mot-clé, ce site sort en premier mais quand je clique, la page est vide et plein de pubs.” Direct, descriptif, pas d’analyse.

Le mode d’emploi anti-signature en 4 étapes

L’objectif n’est pas de désactiver votre cerveau de pro. C’est de traduire votre constat dans une langue qui ne vous identifie pas. Quand vous remplissez le champ texte ouvert, suivez ce protocole en 4 temps. Comptez 15 minutes pour rédiger un rapport propre.

Étape 1 : Réécrire en langage utilisateur

Substituez chaque terme métier par une description factuelle. Tableau de traduction immédiate :

| Jargon SEO | Traduction utilisateur |

|---|---|

| Cannibalisation entre deux URLs | ”Deux pages identiques sur ce site qui sortent toutes les deux quand on cherche X” |

| Cloaking | ”Le site montre un contenu à Google et un autre quand on clique réellement” |

| Thin content | ”Les pages sont quasi vides, le texte ne dit rien d’utile” |

| Doorway pages | ”Une centaine de pages qui se ressemblent toutes, juste pour capter du trafic” |

| Network de PBN | ”Plein de petits sites qui pointent tous vers ce site, tous créés en même temps” |

| Hidden text | ”Du texte invisible à l’écran mais visible quand on regarde le code” |

Ne remplacez pas en mode automatique. Reformulez chaque phrase entière. Si vous gardez “cannibalisation” et que vous traduisez juste “audit” par “vérification”, vous gardez votre signature.

Étape 2 : Citer les URLs sans les annoter

Donnez la liste brute des URLs problématiques. Sans commentaire technique. Le rapporteur Google a le contexte pour interpréter, votre rôle est de pointer, pas d’expertiser. Un internaute pointe. Un pro analyse.

Bon : “Les pages suivantes sont concernées : example.com/page-1, example.com/page-2, example.com/page-3.” Mauvais : “Pattern de doorway pages détecté sur /page-1 à /page-5 avec une similarité supérieure à 90 % en TF-IDF.” La deuxième phrase a fait le travail à votre place. Le rapporteur Google n’a plus besoin d’enquêter, mais il a aussi votre signature.

Étape 3 : Décrire ce que vous observez, pas ce que vous déduisez

Distinguez fait observable de conclusion analytique. C’est la règle de tout journaliste : montrer, pas conclure. Vos observations doivent toutes pouvoir commencer par “je vois”, “je tape ce mot, il sort ça”, “quand je clique, ça affiche…”. Évitez “il y a clairement…”, “le mécanisme utilisé est…”, “cela démontre une volonté de…”.

Bon : “Je tape ‘cosmétiques bio’ et ce site sort 4 fois sur la première page avec 4 URLs différentes qui montrent quasiment le même produit.” Mauvais : “Le site exploite manifestement une stratégie de cannibalisation organique multi-URL pour saturer la SERP.” La première phrase est une observation utilisateur. La deuxième est un memo de consultant.

Étape 4 : Tester avec la règle du voisin

Avant d’envoyer, relisez le rapport et posez-vous cette question : mon voisin non-SEO pourrait-il avoir écrit ça ? Si la réponse est non, vous êtes trop spécifique. Réécrivez. Si vous avez 4 termes que votre voisin ne dirait jamais, vous êtes cramé en cas d’action manuelle.

Cette étape paraît cosmétique. Elle est la plus protectrice. Le filtre du voisin coûte 3 minutes et anonymise sémantiquement votre rapport. Ce n’est pas du remplissage. C’est ce qui fait la différence entre un signalement utile et un signalement signé.

3 cas concrets : ce qui marche, ce qui vous crame

Trois exemples reconstitués, anonymisés, qui montrent la même observation rédigée de 3 façons différentes : un rapport bardé de jargon SEO qui crame son auteur en cas d’action manuelle, un rapport neutre mais inopérant qui ne déclenche rien, un rapport descriptif qui obtient le résultat sans laisser de signature. Tous tirés d’audits réels en accompagnement, où l’option “signaler” a été discutée.

Cas 1 : Le rapport cramé

“Le site domaine-X.fr utilise une stratégie de cloaking en présentant à Googlebot un contenu différent de celui rendu côté navigateur (User-Agent switch). On observe également un network de doorway pages sur /promo/ avec un thin content massif et un netlink profile composé à 78 % de domaines en .biz expirés. Cette configuration enfreint clairement vos guidelines spam policies sections 4.2 et 4.7.”*

Diagnostic : 7 termes jargon en 3 phrases. Référence directe aux sections de la doc Google. Pourcentage précis sur le profil de liens. Aucun internaute n’écrit ça. Probabilité que le site visé identifie un consultant : très élevée. Si le concurrent est connecté dans le milieu, il peut deviner qui en deux questions à ses contacts.

Cas 2 : Le rapport neutre mais inefficace

“Ce site n’a pas un bon contenu. Je pense qu’il triche pour être bien classé. Vous devriez vérifier.”

Diagnostic : zéro signature pro, mais zéro information actionnable. Le rapporteur Google n’a aucun élément. Le signalement va probablement à la pile “spam detection improvement”, pas à la pile “manual action”. Anonymat sémantique : excellent. Efficacité : nulle. Vous n’avez pas perdu votre signature, mais vous n’avez rien gagné non plus.

Cas 3 : Le rapport opérationnel

“Quand je tape ‘[mot-clé]’ sur Google, je trouve ce site en premier. Quand je clique, la page est presque vide et plein de pubs. Si je tape un autre mot autour du même sujet, c’est le même site qui sort, mais avec une page aussi vide. J’ai vu au moins 5 pages comme ça : example.com/page-1, example.com/page-2, example.com/page-3, example.com/page-4, example.com/page-5. Il me semble que ce site pousse plein de pages qui ne servent qu’à capter du trafic, sans vraie information.”

Diagnostic : observations factuelles, vocabulaire simple, URLs listées sans annotation, pattern décrit en termes utilisateur. Anonymat sémantique : préservé. Efficacité : haute. Le rapporteur Google a tout pour enquêter et probablement déclencher une action manuelle si le pattern est confirmé.

La différence entre Cas 1 et Cas 3 est de 4 minutes d’écriture. Mais elle change la donne en cas de transmission verbatim.

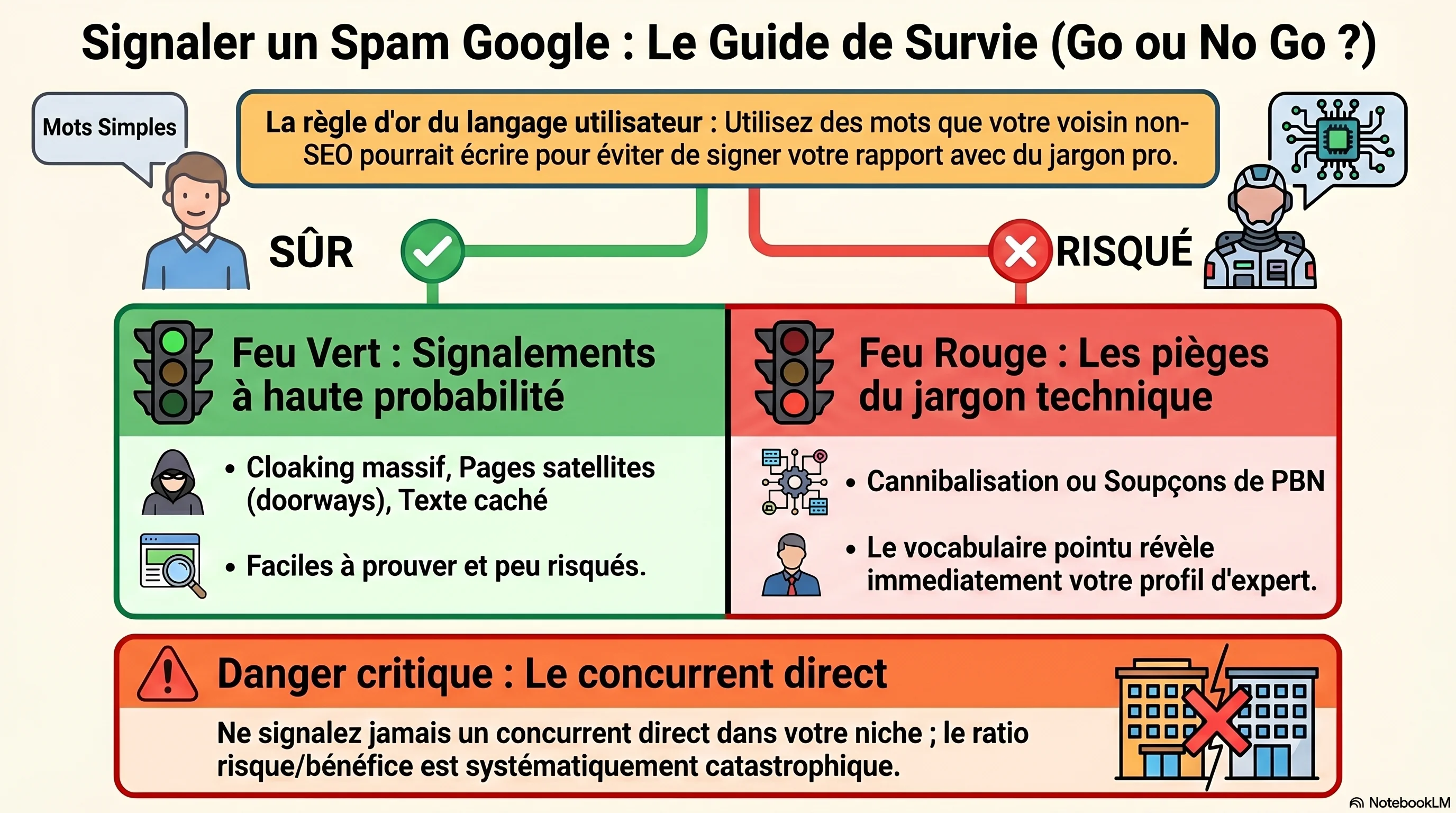

Quand signaler vaut le coup, quand laisser tomber

Tous les patterns spam ne se signalent pas avec le même rapport coût/bénéfice. Plus le pattern est descriptible en mots utilisateur (cloaking visible, doorway pages par centaines, hidden text), plus le signalement est sûr. Plus il faut du jargon pour le décrire (cannibalisation, link velocity, soupçon de PBN), plus vous vous exposez à la signature, sans gain proportionnel d’efficacité. Voici une grille de décision en 4 colonnes : type de spam observé, probabilité d’action manuelle, risque anti-signature, verdict opérationnel.

| Type de spam | Probabilité action manuelle | Risque signature | Verdict |

|---|---|---|---|

| Cloaking massif sur grande surface | Haute | Moyen (vocabulaire visible côté code) | GO si rapport en langage utilisateur |

| Doorway pages par centaines | Haute | Faible (descriptible en mots simples) | GO |

| Hidden text ou texte caché | Haute | Très faible | GO |

| Pure spam algorithmique (sites IA générés) | Moyenne | Très faible | GO |

| Cannibalisation non manipulative | Très faible | Élevé (terme niche) | NO GO. Pas du spam, pas signalable. |

| Soupçon de PBN (réseau de liens) | Faible (dur à prouver) | Très élevé (vocabulaire pointu) | NO GO sauf preuve béton |

| Concurrent direct dans votre niche/ville | N/A | Catastrophique | NO GO. Le ratio risque/bénéfice est défavorable. |

La règle implicite : plus le pattern est descriptible en mots utilisateur, plus le signalement est sûr. Plus il faut du jargon pour le décrire, plus vous vous exposez.

Important : confondre une vraie manipulation avec une simple erreur technique d’URLs dupliquées vous fait perdre votre crédibilité auprès du rapporteur Google. Avant de signaler, auditez le site qu’on signale en amont avec une grille terrain pour confirmer que c’est bien volontaire. Un signalement sur faux positif vous classe en bruit.

Ce que ça change pour votre stratégie SEO

Le signalement spam n’est pas une arme tactique de routine. C’est un outil rare, à utiliser quand le bénéfice concurrentiel dépasse largement le risque de signature. Pour 95 % des consultants SEO francophones, la question ne se pose pas. Pour les 5 % qui ont un concurrent direct vraiment toxique, elle se pose, mais pas avec la légèreté que SEJ a suggérée.

La vraie stratégie reste ailleurs. Trois leviers concrets :

- L’audit anti-pénalité de votre propre site : avant de pointer un concurrent, vérifiez que vos pratiques sont propres. 40 % des audits que je fais révèlent des résidus de prestataires précédents (link velocity douteux, pages doorway oubliées, redirections en cascade) que le client n’a pas vus.

- La diversification de l’acquisition : si la guerre concurrentielle SEO est si tendue qu’il faut signaler des pairs, c’est qu’il faut diversifier l’acquisition au lieu de jouer la guerre concurrentielle. SEO + paid + email + organique social, le mélange dilue le risque.

- Votre crédibilité à long terme : la communauté SEO francophone est petite. Un consultant identifié comme rapporteur compulsif perd des opportunités d’affiliation, des invitations à des conférences, des retours de prospects passés. Le coût relationnel est invisible mais réel.

Si Google a fragilisé l’anonymat des signalements, c’est probablement parce qu’il en reçoit trop. Le verbatim transmis est un filtre. Il oblige le rapporteur à réfléchir avant d’envoyer. C’est une bonne chose pour la qualité moyenne des rapports, et une protection bizarrement asymétrique pour les sites visés.

Pour vous, le vrai changement, ce n’est pas l’autorisation de signaler. C’est l’obligation de signaler bien ou pas du tout.

Le reste, c’est du bruit.

L'analyse en deux voix

Deux consultants discutent de ce sujet — données, cas terrain, implications business.

Lire la version texte

Il y a un scénario assez terrifiant quand on y pense.

Imaginez renvoyer une lettre de dénonciation anonyme à la police pour signaler, je sais pas, les pratiques frauduleuses d'un concurrent féroce.

Ouais, le genre de truc qui arrive tous les jours dans le monde des affaires.

C'est ça.

Sauf que là, le commissariat prend cette lettre, efface votre nom et la transmet mot pour mot avec chaque virgule, chaque tournure de phrase directement sur le bureau de ce fameux concurrent.

Aïe.

Voilà.

L'anonymat technique est respectée.

Pas de nom, pas d'adresse.

Mais la manière d'écrire, elle hurle l'identité de l'auteur.

Et c'est exactement le piège dans lequel une industrie entière est tombée tête la première en avril 2026.

C'est fou parce que l'enthousiasme technologique, il a vraiment cette fâcheuse tendance à aveugler notre esprit critique, tu vois.

Ah oui, complètement.

Toute la presse spécialisée anglo-saxonne et puis la communauté francophone dans la foulée, ils ont célébré une mise à jour de Google comme une victoire majeure.

Jean, enfin une bonne nouvelle pour le SEO.

Exactement.

Le message global, c'était de dire qu'il devenait enfin facile et sécurisé de dénoncer les sites frauduleux.

Sauf que, bah, l'information a été relayée sans que personne ne prenne vraiment le temps d'analyser les implications systémiques du truc.

Et c'est justement ce décalage entre la perception publique et la réalité technique qui rend la matière première de notre décryptage d'aujourd'hui si précieuse.

Tout à fait.

Aujourd'hui, on plonge dans les notes de travail privé d'un consultant SEO indépendant, donc on parle d'un expert e-commerce avec plus de 10 années de terrain, pas d'un théoricien.

Un vrai praticien, quoi.

Voilà.

C'est pas un communiqué de presse tout lit ce qu'on a là.

C'est le carnet de bord d'un mec qui a vraiment disséqué les petits caractères de la nouvelle documentation de Google sur leur formulaire de signalement de spam.

Et ce qu'il a trouvé, ça remet carrément en question la définition même de la confidentialité professionnelle sur le web.

La distinction fondamentale ici, c'est la différence entre l'anonymat technique et l'anonymat sémantique.

L'anonymat sémantique ?

Ouais.

L'anonymat technique, c'est juste une protection informatique de base.

Mais l'anonymat sémantique, c'est l'empreinte que laisse notre propre langage.

Et la faille, elle est exactement dans cette zone grise.

Pour bien comprendre le bouleversement, il faut vraiment regarder sous le capot.

Comment marcher le formulaire report spam de la Search Console avant et surtout après ce fameux 23 avril ?

En apparence, le système a l'air super robuste.

Le consultant note bien que quand on soumet un rapport, Google fait un grand ménage dans les métadonnées.

Donc on est protégés informatiquement parlant ?

Ouais, l'adresse e-mail de l'expéditeur, l'adresse IP de la connexion, le nom du compte Google, tout ça, c'est purement et simplement supprimé.

Donc la fuite ne vient pas des tuyaux techniques.

La compromission, elle est cachée.

Trois paragraphes plus bas dans la nouvelle doc officielle, c'est ça ?

C'est ça.

Il y a une clause qui dit que s'il signalement aboutit à une action manuelle, donc si un évaluateur humain de Google décide de pénaliser le site fautif, l'intégralité du texte tapé dans le champ libre est transmise au propriétaire du site sanctionné.

L'intégralité ?

100%.

Google appelle ça une transmission verbatim.

Une restitution littérale, mot pour mot.

En gros, le concurrent reçoit l'argumentaire complète son accusateur.

J'imagine que dans l'esprit de Google, l'idée, c'est d'aider le site pénalisé à comprendre pourquoi il a été sanctionné.

Sûrement oui.

Mais reprenons mon analogie de la lettre de dénonciation.

C'est comme si on découpait méticuleusement des lettres dans un vieux magazine pour cacher son écriture.

Avec les petits gants pour pas laisser d'empruntre.

Grave, le masque technique parfait.

Mais dans le texte de la lettre, tu utilises le surnom ultra intime de la personne où tu fais référence à un repas de famille précis.

Voilà, la signature sémantique te trahit totalement.

C'est un truc de dingue.

Et le plus révélateur, d'après les notes du consultant, c'est la précipitation avec laquelle Google a sorti cette mise à jour.

Ah ça, c'est fascinant !

C'est une vraie investigation qu'il a menée.

Il a inspecté le code source de la documentation officielle à la date du 7 mai.

Et il a vu que les balises schema.org du pied de page avaient même pas été mises à jour.

Attends, les balises schema.org, c'est quoi exactement pour ceux qui sont moins techniques ?

C'est le code invisible pour l'humain, mais qui structure les données pour les moteurs de recherche et pour les LLM, tu sais, les intelligences artificielles, ça les aide à comprendre le contexte de la page.

D'accord.

Et ce code, qui était obsolète, affirmait encore que Google ne prenait aucune action directe suite à ses rapports de spam.

Donc ils ont repeint la façade publique à la hâte, mais l'ancien plan de construction traînait encore dans la cave quoi.

C'est exactement ça.

Et en utilisant la Wayback Machine, le site qui archive les anciennes versions des pages web, le consultant a prouvé que l'ancienne politique était toujours en vigueur le 11 avril.

Donc la bascule s'est faite en 12 jours.

12 petits jours.

Pour modifier un protocole de modération à l'échelle mondiale, c'est incroyablement rapide.

C'est clair que ça sent la panique à bord.

Ouais, ça montre une urgence opérationnelle interne évidente.

Il voulait très probablement réduire drastiquement le volume de requête abusif qu'il recevait.

Et cette urgence a créé ce que le consultant appelle une trahison par le vocabulaire.

La trahison par le vocabulaire.

C'est super bien trouvé comme expression.

Bah un professionnel du référencement, ça utilise un dialecte ultra spécifique.

Donc si tu rédiges un rapport avec ce dialecte et que ça atterrit sur le bureau d'un concurrent qui baigne aussi dans le web marketing...

Bah il te crée tout de suite.

C'est un jour d'enfant d'en retrouver qui a écrit ça.

Et dans ces notes, le consultant isole 5 marqueurs lexico.

5 mots qui sont la garantie absolue de révéler que t'es un pro de l'industrie.

Le premier sur la liste, c'est la cannibalisation.

Ouais, un terme assez fascinant d'ailleurs.

C'est qu'en deux pages de ton propre site se battent pour le même mot clé dans les résultats de Google.

Un internaute normal et dirais juste un truc du genre le site tourne en rond ou une propose de fois la même chose.

Exactement.

Rien que d'utiliser le mot cannibalisation, ça dit direct au modérateur de Google et donc au concurrent ciblé, que le texte vient d'un vrai audit professionnel.

Ensuite, il y a le maillage interne.

Pareil, un utilisateur classique y navigue, il clique sur des menus.

Il ne va jamais parler d'une architecture de lien construite pour répartir l'autorité d'une page.

C'est du vocabulaire exclusif au métier du web.

On a aussi le fameux cloaking.

Pour vulgariser, c'est le fait de montrer une belle page super clean au robot de Google.

Mais une fois que le visiteur humain clique, on lui affiche une page complètement différente.

Genre bourrée de pub ou de trucs douteux.

C'est ça.

Le consultant souligne aussi la link Velocity, donc la vitesse artificielle à laquelle un site gagne des liens externes pour gonfler sa popularité.

Un utilisateur lambda ne surveille pas la vitesse d'acquisition des liens d'un site e-commerce, tu vois.

Clairement pas.

Et le dernier marqueur, c'est le thin content.

Ouais, encore une fois, une personne mécontente dira juste cette page évide où l'article est nul.

Mais thin content, c'est carrément la nomenclature clinique des ingénieurs de Google.

Mais ce qui est fou, c'est que le danger va bien au-delà de ces simples mots.

La structure même de nos phrases devient une vraie en pointe digitale.

Absolument.

Il y a un passage dans l'analyse qui m'a vraiment marqué.

Le consultant donne un exemple de phrase.

Sur les pages de collection, on observe un profil suspect, avec 87% de domaines référents provenant d'extensions en points rues.

Voilà, typiquement, le simple fait de donner un ratio chiffré aussi précis, ça implique que t'as utilisé des logiciels d'analyse pro qui coûtent une fortune.

Un acheteur normal, il calcule pas le pourcentage géographique des liens pendant qu'il achète ses chaussures, quoi.

C'est sûr.

Et le fait de croiser plusieurs concepts techniques dans une même phrase joue le même rôle d'alarme, non ?

Ah oui, le croisement, c'est fatal.

Si tu écris un truc genre la balise canonicale contredit l'architecture déclarée dans le fichier sitemap.xml, là, t'as superposé plusieurs couches d'ingénierie.

Ça signale un niveau d'expertise très avancé.

Alors que le profane y dirait juste « Je cherche un produit, je clique, ça marche pas et il y a des erreurs ».

C'est ça, il reste factuel et linéaire.

Mais attends, j'ai une vraie question là-dessus.

Il y a un paradoxe énorme.

Pourquoi Google pénaliseraient cette expertise ?

Je veux dire, si j'utilise le bon jargon, que je structure ma pensée, que je pointe direct le conflit entre le sitemap et la balise, ça devrait faire gagner un temps dingue à l'employé de Google qui lit le rapport, non ?

Mais c'est ça qui est complètement ironique.

C'est une excellente question.

Parce que oui, utiliser leur jargon, ça aide énormément le diagnostic en interne.

L'algorithme prétrit plus vite et l'employé va droit au but.

Donc on les aide.

On devient le parfait petit assistant de Google.

Mais le paradoxe est le prix de cette efficacité.

En leur machant le travail, on se sacrifie sur l'hôtel du verbatim.

C'est une arme à double tranchant.

Exactement.

La clarté technique qu'on offre à Google se transforme en arme de désanonymisation massive dès que le rapport est transféré au fautif.

Donc, ce jargon qu'on a mis des années à maîtriser, il est devenu toxique.

Et la suite logique de l'analyse du consultant, c'est comment survivre à ça ?

Comment tu fais un signalement assez fort pour que Google agisse sans que tes mots te trahissent ?

Le consultant a développé ce qu'il appelle le protocole anti-signature.

C'est une méthode très stricte en quatre étapes qui prend à peu près 15 minutes pour anonymiser sémantiquement un rapport.

Et ça demande un vrai effort mental.

C'est marrant, ça m'a fait penser à l'histoire du chirurgien orthopédique qui serait témoin d'un accident de la route.

Ah oui, l'analogie est parfaite !

S'il appelle les secours et qu'il dit « on a une fracture comminutive du fémur distal » au centre d'appel ils savent direct que c'est un confrère.

C'est grillé.

Donc pour rester un simple témoin civil, il doit vraiment faire violence à son cerveau et dire un truc banal, genre « la jambe est tordue au-dessus du genou et le salaire cassé ».

L'information vitale passe, mais son identité professionnelle reste masquée.

Et c'est exactement la gymnastique qu'impose ce protocole.

La première étape, c'est de réécrire le problème en langage strictement utilisateur.

Tu parles pas de cloaking, tu forces le côté descriptif genre « Le résultat sur Google me promettait un article sur les plantes, mais quand je clique, je vois que des pubs pour des casinos ».

Simple, basique.

Voilà, la deuxième étape, c'est d'interdire formellement tout annotation du RL.

C'est-à-dire ?

Bah le réflexe d'un référenceur, c'est de lister des adresses web et d'ajouter une analyse, genre la densité de mots-clés ou le TF-IDF de chaque page.

Là, la règle, c'est de pointer du doigt bêtement.

Tu donnes la liste brute, tu fais pas le travail de l'outil de Google à sa place.

D'accord, on liste comme un internet.

Et la troisième étape ?

C'est la règle d'or, des journalistes, d'écrire au lieu de déduire.

En tant qu'expert, on veut toujours conclure.

On veut dire, cette mécanique prouve une manipulation de l'algorithme.

On veut montrer qu'on a compris.

C'est ça l'erreur.

Le protocole oblige à rester au niveau des symptômes.

Il faut commencer ces phrases par « je vois » ou « quand je clique » plutôt que par « cette architecture démontre que ».

Ah ouais, c'est subtil mais hyper puissant.

Et alors, la quatrième étape, le filtre ultime.

La fameuse règle du voisin ?

J'adore ce concept.

C'est le filtre protecteur de 3 minutes avant de cliquer sur « envoyer ».

Tu relis ton texte et tu te poses une seule question.

Est-ce que mon voisin, qui n'y connaît rien dans création de site web, pourrait écrire cette plainte naturellement ?

Si la réponse est non, tu effaces et tu recommences.

Et les notes donnent trois cas pratiques pour illustrer tout ça.

Prenons l'exemple d'un site qui fait du user agent switch, donc un script qui détecte si tu es un robot ou un humain, couplé à des doorways page, des pages créées juste pour aspirer le trafic.

Ouais, une belle arnaque classique.

Le premier cas, c'est ce que le consultant appelle le rapport cramé.

Celui qui est bourré de jargon, qui liste les pourcentages et qui cite carrément les règles juridiques de Google.

Ça, avec la nouvelle règle du verbatim, c'est un suicide professionnel.

Le mec en face sera direct qu'il a été audité par une agence concurrente.

À l'autre extrême, on a le deuxième cas, le rapport neutre mais inefficace.

Genre ceci de triche, le contenu est nul, merci de vérifier.

Alors là, il y a l'anonymat est total, le voisin aurait pu l'écrire, c'est sûr.

Mais les problèmes, c'est que ça sert à rien.

Il n'y a aucune info factuelle, donc l'évaluateur de Google va juste mettre ça à la poubelle.

Il ne faut pas rêver, ils ne vont pas enquêter sur une plainte aussi vague.

C'est là qu'on arrive au troisième cas, le rapport opérationnel.

Exact. C'est l'équilibre parfait entre l'effet et la naïveté linguistique.

Ça donnerait un truc comme « En cherchant ce modèle de vélo précis, je tombe toujours sur ce site en premier. » Mais la page à pas de texte, il y a les pleines de pubs bizarres.

J'ai eu le même soucis sur ces cinq autres pages.

Voici les liens.

On dirait que c'est juste fait pour nous faire cliquer sur des pubs.

La piste est super claire pour Google, il y a la preuve des liens, mais l'empreinte sémantique de l'auteur est totalement invisible.

C'est brillant, mais ça demande un effort conscient énorme.

Mais carrément, c'est épuisant de devoir amputer son propre vocabulaire comme ça.

Et d'ailleurs, le consultant soulève la vraie question.

Si ça demande tant d'énergie, est-ce que ça vaut encore le coup de signaler chaque petite infraction de la concurrence ?

Et la réponse, c'est que le signalement n'est plus un réflexe de routine.

C'est devenu une gestion du risque.

Il a même créé une grille de décision.

La règle d'or étant « Plus le problème est facile à décrire avec des mots de tous les jours, plus on peut signaler en sécurité ».

Voilà. Donc on a les feux verts.

Le cloaking massif, les textes cachés grossièrement, ou les spams générés par des IA complètement nul.

Les trucs qui sont tailleux, quoi.

C'est ça. N'importe quelle internet trouverait sa suspecte.

Là, le risque est faible. Probabilité d'action haute.

Mais alors, les feux rouges ?

Les feux rouges, c'est les trucs invisibles.

Genre la cannibalisation, ou si tu soupçonnes un concurrent d'utiliser un réseau privé de blogs, les fameux PBN.

Ah ouais, prouver un PBN sans utiliser de jargon, bonne chance.

C'est quasi impossible.

Le risque est énorme, pour un résultat très incertain.

Et il y a un feu rouge absolu, d'ailleurs, dénoncer un concurrent direct sur un marché local.

Oh là là, le risque catastrophique !

Ah bah t'imagines !

Deux artisans sur la même petite ville, sur la même niche, si l'un dénonce l'autre et que le rapport verbatim m'arrive.

Même avec le protocole anti-signature, par simple déduction, le gars va savoir qu'il a balancé.

Exactement.

Et dans une petite communauté régionale, être vu comme le mec qui essaie de couler ses confrères par derrière, ça détruit ta réputation.

Tu perds tes partenariats, ton réseau, tous évaporent.

Donc face à tout ça, le consultant propose trois grands leviers stratégiques pour les agences.

Plutôt que de passer son temps à fliquer les autres, il faut faire quoi ?

Bah le premier levier, c'est l'introspection.

Auditer son propre site d'abord.

Faut savoir que près de 40% des sites e-commerce sont encore des résidus toxiques laissés par de vieilles agences.

Ouais, les vieux squelettes dans le placard.

C'est ça. Si tu signales inconcurrents, tu invites la police de Google à inspecter tout le quartier.

Y compris chez toi. Vaut mieux être irréprochable.

Très juste. Et le deuxième levier ?

La diversification du trafic.

Si t'es obsédée par la triche de ton concurrent sur Google, c'est souvent parce que tu dépends à 100% du trafic organique.

Faut diversifier avec des newsletters, les réseaux sociaux, la pub payante.

Ça te rend moins vulnérable et donc moins parano.

Et le troisième levier, c'est de protéger sa réputation.

On en a parlé.

Donc en résumé, l'époque où on pouvait nettoyer ses concurrents discrètement via un petit formulaire, c'est de l'histoire ancienne.

Totalement révolue.

L'anonymat technique ne nous protège plus de notre propre empreinte sémantique et la nouvelle règle du jeu, c'est vraiment de signaler parfaitement ou de pas signaler du tout.

Et tu sais, au fond, je pense que c'était le but de Google depuis le début.

Tu crois ?

Bah oui.

Ce passage au verbatim, c'est sûrement pas une maladresse.

C'est un filtre psychologique délibéré.

Ils ont instauré une friction gigantesque pour désengorger leurs équipes de modération.

Ils en avaient marre de gérer les petites vengeance entre agences SEO.

Vu comme ça, c'est redoutablement intelligent.

C'est brillant.

Et d'ailleurs, ça m'amène à une réflexion finale un peu provocatrice pour ceux qui nous écoutent.

Vas-y, je suis curieux.

Si on part du principe que notre choix de mots suffit à trahir notre identité professionnelle et que les géants de la tech utilisent nos propres rapports verbatim pour nous intimider vers quel futur on va.

C'est vrai que ça fait réfléchir.

Est-ce qu'on arrive à un stade où pour communiquer avec ces méga-platformes, il va falloir développer autant de stratégies, de camouflage de notre expertise, que de stratégies pour notre propre métier.

Le camouflage sémantique comme compétence vitale.

C'est ça.

Et si demain, la compétence la plus prisée d'un ingénieur en algorithmiques ou d'un expert en intelligence artificielle, c'était paradoxalement l'art de se faire passer pour un parfait idiot ?

Wow, l'art de jouer à la mateur pour survivre au système qu'on a nous-mêmes compris.

C'est une super question pour clôturer ce décryptage.

Il y a vraiment de quoi y réfléchir à deux fois avant de remplir le prochain formulaire en ligne.

Formuler un signalement spam Google sans trahir votre signature pro

Durée : 15 min- 1

Réécrire en langage utilisateur

Substituez chaque terme métier par une description factuelle qu'un internaute lambda pourrait écrire. Au lieu de 'cannibalisation entre deux URLs', écrire 'deux pages qui semblent identiques sur ce site'.

- 2

Citer les URLs sans annoter

Listez les URLs problématiques sans commentaire technique. Le rapporteur Google a le contexte pour interpréter, votre rôle est de pointer, pas d'expertiser.

- 3

Décrire ce que vous observez

Distinguez le fait observable (je vois ce texte sur la page) de l'analyse pro (cloaking détecté). Restez côté observation.

- 4

Tester avec la règle du voisin

Si votre voisin non-SEO ne pourrait pas écrire ce rapport tel que vous l'avez rédigé, vous êtes trop spécifique. Réécrivez en simplifiant.

Questions fréquentes

Le formulaire de signalement spam Google reste-t-il anonyme ?

Oui techniquement, mais incomplètement. Google retire votre email, votre IP et votre nom de compte avant de transmettre le rapport au site. Tout ce que vous écrivez dans le champ texte ouvert est transmis verbatim, donc votre style d'écriture peut vous identifier.

Que devient mon signalement après envoi ?

Si Google déclenche une action manuelle suite à votre rapport, le texte exact de votre signalement est envoyé au propriétaire du site visé pour qu'il comprenne le contexte. Sans action manuelle, le rapport reste dans la file d'amélioration des systèmes de détection.

Puis-je signaler un concurrent direct sans risque ?

Risque opérationnel oui, à 2 niveaux. Niveau 1 : votre vocabulaire pro peut faire deviner qu'un pair vous a signalé. Niveau 2 : si votre concurrent identifie votre signature et qu'il est connecté dans la communauté SEO, votre relation pro et votre réputation peuvent en souffrir. Le rapport reste anonyme techniquement, mais sémantiquement il peut vous trahir.